Arrêtez de penser au matériel et commencez à réfléchir aux arbitrages économiques. La clé d’une infrastructure d’IA évolutive ne consiste pas seulement à acheter les GPU les plus rapides, mais à maîtriser le jeu impitoyable de l’arbitrage de calcul, des limites de densité thermique et des seuils de rentabilité entre achat et location.

- Les instances spot du cloud offrent jusqu’à 90 % de réduction de coût, mais nécessitent une architecture conçue pour la préemption.

- Les installations sur site sont limitées par la densité thermique (kW/rack), pas seulement par l’espace, le refroidissement liquide devenant obligatoire au-delà de 50 kW.

Recommandation : Adoptez un modèle hybride « Charge de base et Pic » (Base-load and Burst) : utilisez une installation sur site rentable pour la R&D continue et basculez vers le cloud pour les cycles d’entraînement massifs et peu fréquents afin d’obtenir l’équilibre optimal entre coût et échelle.

Pour un Lead Data Engineer dans une startup d’IA, le mandat est clair : livrer des modèles de pointe sans le budget illimité d’un géant de la tech. La réalité brutale est qu’un seul cycle d’entraînement d’IA peut consommer plus de ressources en une semaine que votre plateforme d’analyse entière en un an. Le conseil par défaut — « utilisez des GPU » — est le minimum requis, pas une stratégie. Le véritable défi n’est pas seulement d’atteindre la performance ; c’est de l’atteindre sans brûler votre capital (runway). La plupart des guides parleront de la flexibilité du cloud ou du contrôle sur site, mais ils passent à côté de l’essentiel.

L’approche commune se concentre sur un choix statique entre les spécifications matérielles ou les fournisseurs de cloud. C’est un jeu perdant. Cela ignore les réalités économiques et dynamiques des charges de travail d’IA où les coûts ne sont pas linéaires et où les goulots d’étranglement de performance se trouvent rarement là où on les attend. On vous dit de rapprocher vos données du calcul, mais pas les schémas architecturaux pour y parvenir sans frais de transfert de données paralysants. On vous conseille de surveiller l’utilisation, mais on ne vous dit pas quoi faire quand votre CPU est inactif alors que votre application rampe.

Mais et si tout le cadre de réflexion était erroné ? Et si l’architecture pour le traitement intensif n’était pas un problème matériel, mais un problème financier et stratégique ? Le véritable levier ne réside pas dans la puissance brute de votre silicium, mais dans votre capacité à exploiter les inefficacités économiques des tarifs du cloud, à maîtriser les limites physiques de la densité thermique et à identifier le moment exact où la location de calcul devient plus coûteuse que sa possession. Il s’agit de construire une structure de calcul aussi astucieuse financièrement que puissante techniquement.

Ce guide décortique les points de décision critiques qui séparent les startups qui passent à l’échelle de celles qui font faillite. Nous irons au-delà des platitudes pour explorer les arbitrages architecturaux et économiques fondamentaux que vous devez maîtriser pour construire une infrastructure véritablement performante et rentable pour vos charges de travail d’IA les plus exigeantes.

Sommaire : Architecturer votre maillage de calcul haute performance

- Pourquoi l’entraînement de votre modèle prend une semaine sur CPU mais des heures sur GPU ?

- Comment planifier les tâches lourdes la nuit pour économiser 50 % sur les coûts ?

- Louer des GPU cloud ou acheter une installation : à quel point d’utilisation faut-il acheter ?

- L’oubli du refroidissement qui ralentit votre traitement intensif sur site

- Comment déplacer le calcul vers les données pour réduire le temps de traitement ?

- Modèles d’IA ou régression simple : qu’est-ce qui est le mieux pour les prévisions de ventes ?

- Pourquoi votre application est-elle lente alors que l’utilisation du CPU semble faible ?

- Comment gérer efficacement la capacité de calcul pour les charges de travail haute performance ?

Pourquoi l’entraînement de votre modèle prend une semaine sur CPU mais des heures sur GPU ?

L’écart de performance massif entre les CPU et les GPU pour l’IA n’est pas seulement une question de vitesse d’horloge brute ; c’est une question de spécialisation architecturale. Un CPU est un généraliste, avec quelques cœurs puissants conçus pour des tâches séquentielles. Un GPU, en revanche, est une armée de spécialistes composée de milliers de cœurs plus petits et efficaces, conçus pour le traitement parallèle. Le deep learning est fondamentalement une série de multiplications matricielles massives — un problème de « parallélisme massif » que les GPU sont programmés pour écraser. Cette architecture parallèle explique pourquoi une tâche d’entraînement qui prend une semaine sur un CPU multicœur peut être achevée en quelques heures sur un seul GPU haut de gamme.

Cependant, l’accès à cette puissance a un prix élevé. La véritable question stratégique n’est pas de savoir *si* vous devez utiliser des GPU, mais *comment* vous pouvez vous permettre de les utiliser à grande échelle. Le coût des GPU haut de gamme à la demande peut être prohibitif. La clé est de comprendre le spectre coût-performance. Par exemple, une analyse de coût récente montre qu’un pod de 8 GPU H100 peut passer de 98,32 $ l’heure à la demande à seulement 19,66 $ en instances spot — une économie de 80 %. Cela transforme l’équation économique, rendant la puissance de calcul massive accessible si votre architecture peut gérer la nature éphémère de la tarification spot. Choisir le bon matériel est une première étape critique pour équilibrer performance et budget.

Plan d’action : Optimisez votre sélection matérielle pour l’entraînement de l’IA

- Évaluez les besoins de la charge de travail : Déterminez si vous avez besoin d’un entraînement à échelle modérée, où un NVIDIA A100 (40-80 Go) est suffisant, ou d’un entraînement distribué à grande échelle qui exige la puissance d’un H100 (80 Go).

- Évaluez les besoins de précision : Si vos modèles peuvent exploiter une précision moindre pour un débit plus élevé, choisissez le H100 pour son support natif du FP8. Pour des charges de travail mixtes (graphismes et IA), le L40S pourrait offrir un meilleur équilibre.

- Alignez-vous sur les contraintes budgétaires : Pour la R&D et l’expérimentation au stade précoce, une RTX 4090 grand public (24 Go) peut être un point de départ rentable. Réservez les GPU de classe entreprise pour la production et les cycles d’entraînement critiques.

- Planifiez l’évolutivité multi-GPU : Assurez-vous que la plateforme choisie supporte des interconnexions à large bande passante comme NVLink. C’est non négociable pour l’entraînement distribué sérieux, afin d’éviter que l’interconnexion ne devienne le goulot d’étranglement.

- Mettez en place un refroidissement adéquat : Ne sous-estimez pas la gestion thermique. Les clusters de GPU fonctionnant à 50-100 kW par rack sont courants et nécessitent absolument des solutions de refroidissement liquide de qualité professionnelle pour éviter le bridage thermique (thermal throttling) et les pannes matérielles.

How to Schedule Heavy Jobs Overnight to Save 50% on Costs?

Planifier les tâches pendant la nuit n’est pas seulement une question de courtoisie envers vos collègues ; c’est une stratégie centrale d’arbitrage de calcul — exploiter les fluctuations de prix des fournisseurs de cloud pour réduire considérablement les coûts. Les fournisseurs de cloud disposent de centres de données massifs avec une demande fluctuante. Pendant les heures creuses (comme les nuits et les week-ends), ils vendent leur capacité excédentaire sous forme d’« Instances Spot » (AWS, Azure) ou de « VM préemptibles » (Google Cloud) avec des remises allant jusqu’à 90 % par rapport aux tarifs à la demande. Ce n’est pas une économie mineure ; c’est un changement de donne pour les startups aux budgets serrés.

L’impact est profond. Selon certains rapports, de grandes entreprises technologiques rapportent que Spotify réalise 71 % d’économies, ce qui se traduit par plus de 8,2 millions de dollars par an, en s’appuyant sur ce modèle. Le piège ? Ces instances peuvent être résiliées avec un préavis très court (de 30 secondes à 2 minutes). Pour les utiliser efficacement, vos tâches d’entraînement doivent être tolérantes aux pannes. Cela signifie mettre en œuvre un système robuste de points de contrôle (checkpointing) où l’état de votre modèle est sauvegardé fréquemment (par exemple, toutes les 15-30 minutes). Lorsqu’une instance est préemptée, votre planificateur de tâches peut simplement reprendre l’entraînement à partir du dernier point de contrôle sur une nouvelle instance spot, minimisant ainsi le travail perdu.

Ce tableau issu d’une analyse récente des marchés de GPU spot détaille les offres des principaux fournisseurs de cloud, soulignant les compromis entre économies et préavis de résiliation.

| Fournisseur | Économies | Préavis de résiliation | Idéal pour |

|---|---|---|---|

| AWS Spot | Jusqu’à 90 % | 2 minutes | Plus large sélection de GPU |

| Google Cloud Spot | 60-91 % | 30 secondes | Prix stables, disponibilité A100/H100 |

| Azure Spot | Jusqu’à 90 % | 30 secondes | Remises maximales en heures creuses |

Louer des GPU cloud ou acheter une installation : à quel point d’utilisation faut-il acheter ?

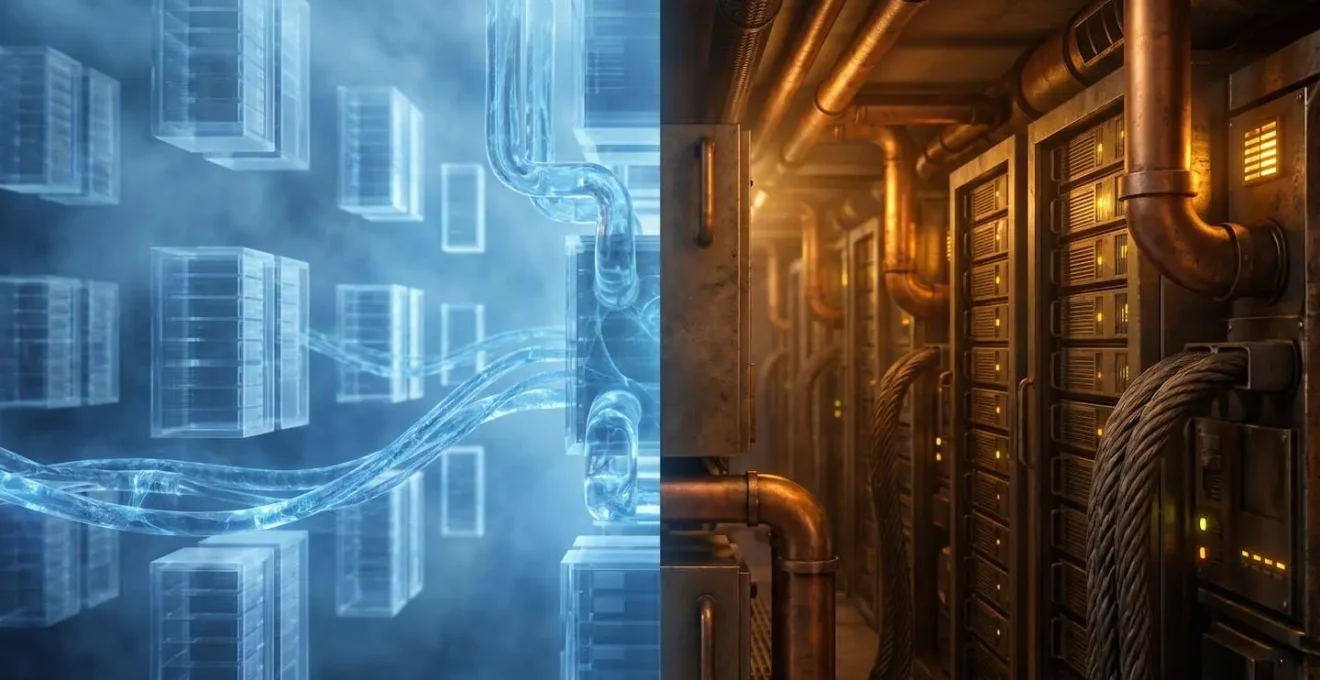

Le débat « louer ou acheter » est l’une des décisions financières les plus critiques pour une startup d’IA. Le cloud offre une élasticité inégalée et l’accès au matériel le plus récent sans dépenses d’investissement initiales. Une installation sur site promet un coût total de possession (TCO) inférieur au fil du temps, mais au prix de la flexibilité et d’un investissement initial important. La réponse n’est pas un simple choix binaire ; il s’agit d’identifier votre seuil de rentabilité d’utilisation. Vous devez calculer le point auquel le coût cumulé de la location de GPU cloud dépasse le coût de l’achat, de l’hébergement et de la maintenance de votre propre matériel.

Ce calcul dépend de vos modèles de charge de travail. Si votre besoin de calcul intensif est sporadique — un cycle d’entraînement massif une fois par trimestre — le cloud est le vainqueur incontesté. Acheter une installation multi-GPU coûteuse qui reste inactive 90 % du temps est une faute de gestion financière. Cependant, si votre équipe de data science nécessite un accès 24h/24 et 7j/7 aux GPU pour l’expérimentation continue, la recherche et l’entraînement de modèles plus petits, le coût de la location constante de cloud devient rapidement astronomique. C’est là que le sur site brille.

Pour la plupart des startups en croissance, la solution optimale n’est pas l’un ou l’autre, mais une approche hybride sophistiquée. Cette stratégie tire le meilleur des deux mondes, créant une structure de calcul rentable et évolutive.

Étude de cas : L’architecture « Charge de base et Pic » (Base-load and Burst)

Les organisations d’IA de premier plan mettent souvent en œuvre une architecture hybride « Charge de base et Pic ». Elles investissent dans une installation sur site de taille modérée pour gérer la charge de base prévisible et continue (24h/24 et 7j/7) d’expérimentation et de développement de leurs équipes de data science. Cela garantit que leurs actifs les plus précieux (ingénieurs et chercheurs) ne sont jamais inactifs en attendant des ressources. Pour les cycles d’entraînement massifs, peu fréquents et gourmands en ressources qui submergeraient leur capacité sur site, elles basculent (« burst ») vers le cloud, exploitant son élasticité quasi infinie. Cela évite le coût en capital de la construction d’un cluster massif sur site qui resterait inactif la plupart du temps, tout en offrant une échelle illimitée lorsqu’elle est cruciale.

L’oubli du refroidissement qui ralentit votre traitement intensif sur site

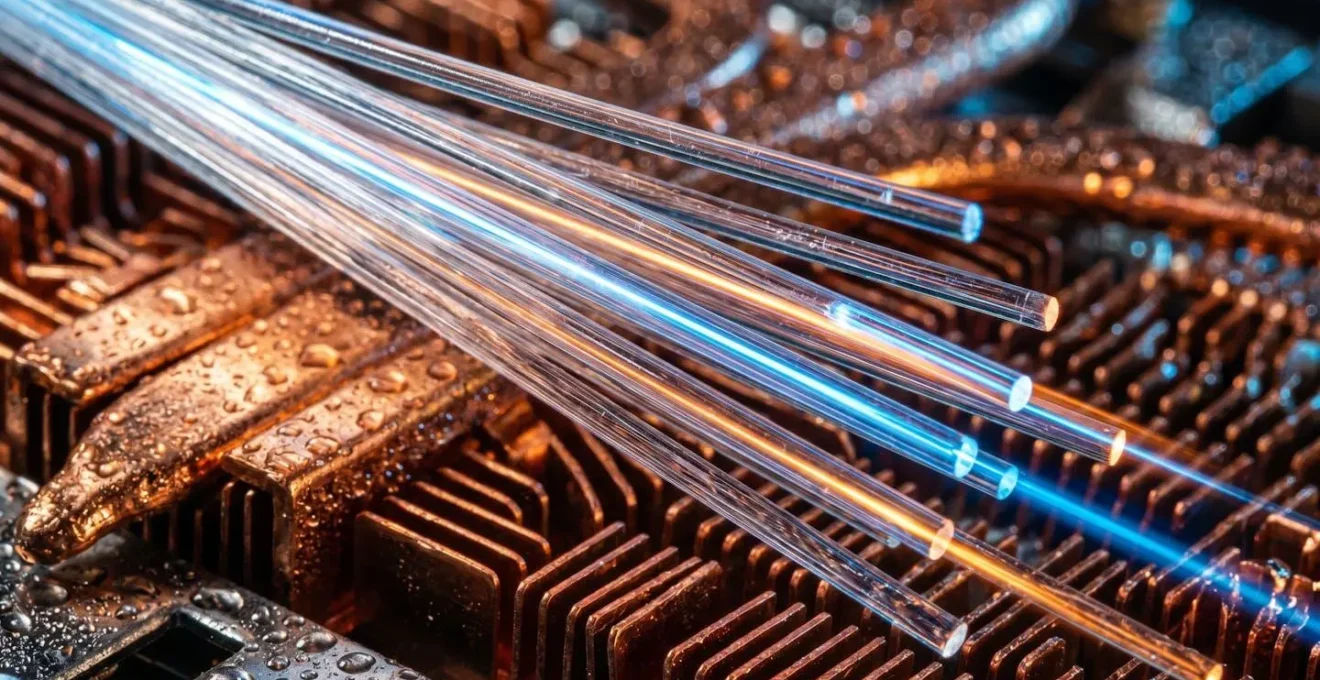

Lors de la construction d’une installation GPU sur site, il est facile de se focaliser sur les processeurs eux-mêmes, mais le tueur silencieux de performances est presque toujours la chaleur. Un seul GPU haut de gamme peut consommer plus de 700 watts en charge, et un rack de serveurs standard rempli de 8 d’entre eux peut facilement dépasser 10-15 kW de puissance thermique. Le refroidissement par air traditionnel, conçu pour des serveurs CPU de plus faible densité, ne peut tout simplement pas faire face. À mesure que vous passez à l’échelle, vous atteignez une limite physique dure appelée densité thermique, où l’air de votre salle de serveurs ne peut plus dissiper la chaleur efficacement. Le résultat est le bridage thermique (thermal throttling) : vos GPU à plusieurs milliers de dollars ralentissent automatiquement pour éviter la surchauffe, effaçant silencieusement la performance que vous avez payée.

Ce n’est pas seulement un problème de performance ; c’est un problème de fiabilité et de coût. Selon une étude de l’Uptime Institute, les pannes de systèmes de refroidissement représentent 13 % de toutes les pannes de centres de données, la majorité de ces incidents coûtant aux entreprises plus de 100 000 $. Ignorer votre architecture thermique est une menace directe tant pour le temps d’entraînement de votre modèle que pour les résultats financiers de votre entreprise. Pour tout déploiement sérieux sur site, la planification du refroidissement est aussi importante que la planification du calcul.

L’industrie se tourne rapidement vers le refroidissement liquide comme seule solution viable pour les clusters de GPU à haute densité. Bien qu’il représente un coût initial plus élevé, son efficacité et sa capacité à gérer des charges thermiques extrêmes en font une nécessité pour les équipes obsédées par la performance.

Étude de cas : CoreWeave repousse les limites du refroidissement par air

Les limites du refroidissement par air ne sont pas théoriques. À une densité de puissance de rack de 50 kW, le refroidissement par air traditionnel atteint ses limites physiques, nécessitant un débit d’air impraticable de 7 850 CFM par rack. Le fournisseur de cloud CoreWeave a été confronté à ce défi lors de l’expansion de ses offres GPU. En mettant en œuvre un refroidissement liquide direct sur puce, ils ont atteint des densités de rack de 130 kW stupéfiantes. Une étude de cas sur leur mise en œuvre a montré que cela a entraîné 10 à 21 % d’économies d’énergie et une réduction de 40 % des coûts de refroidissement par rapport aux méthodes traditionnelles refroidies par air. Plus important encore, ils ont constaté une amélioration de 20 % de l’utilisation globale du système, prouvant qu’un refroidissement efficace se traduit directement par un calcul plus efficace et plus puissant.

Comment déplacer le calcul vers les données pour réduire le temps de traitement ?

L’un des plus vieux adages du calcul haute performance est « déplacez le calcul vers les données, pas l’inverse ». Pour les charges de travail d’IA qui traitent des téraoctets ou même des pétaoctets de données, ce principe est plus critique que jamais. La latence et le coût associés au déplacement de jeux de données massifs sur un réseau ou entre le stockage et les nœuds de calcul peuvent facilement devenir le goulot d’étranglement principal, éclipsant le temps de traitement réel. Si vos GPU sont inactifs en attendant que les données leur soient envoyées, vous avez un problème d’E/S, pas un problème de calcul. Concevoir une architecture favorisant la localité des données est essentiel pour maximiser l’utilisation de vos ressources GPU coûteuses.

Atteindre la localité des données nécessite une conception architecturale consciente qui minimise la distance et la friction entre votre stockage et vos processeurs. Cela va au-delà du simple fait de placer vos serveurs dans le même centre de données. Cela implique l’utilisation de systèmes de fichiers haute performance, de frameworks de calcul distribué et d’une architecture de données conçue pour un accès parallèle dès le départ.

Plusieurs schémas architecturaux ont émergé pour résoudre ce défi, chacun adapté à des échelles et des cas d’utilisation différents. L’objectif est toujours le même : s’assurer que lorsqu’un processus de calcul démarre, ses données requises sont déjà locales ou accessibles avec une latence minimale.

- Schéma 1 – Colocation native dans le cloud : L’approche la plus simple. Placez vos instances de calcul (comme EC2) et votre stockage objet (comme S3) dans la même région cloud et la même zone de disponibilité (AZ). Pour combler l’écart entre le stockage objet et les besoins de haute performance, utilisez un système de fichiers parallèle comme AWS FSx for Lustre, qui présente une interface de fichiers à haut débit adossée à S3.

- Schéma 2 – Frameworks distribués : Pour des jeux de données véritablement massifs, utilisez des frameworks comme Ray ou Dask. Ces outils peuvent partitionner vos données en fragments (shards) distribués sur un cluster de nœuds de travail. Au lieu de déplacer les données, ils sérialisent votre code Python et l’envoient aux nœuds de travail pour qu’il soit exécuté sur leurs fragments de données locaux, parallélisant l’opération et éliminant les goulots d’étranglement de transfert de données.

- Schéma 3 – Edge Processing (Traitement en périphérie) : Pour l’IoT et les applications en temps réel, déplacer les données brutes des capteurs vers un cloud central est inefficace. Déployez plutôt des modèles d’inférence plus petits directement sur les sites périphériques (usines, magasins, etc.). Cela traite les données là où elles sont générées, envoyant seulement les résultats ou les insights au serveur central, réduisant ainsi considérablement le volume de transfert de données.

- Schéma 4 – Architecture Data Lakehouse : Les plateformes modernes comme Databricks ou Snowflake sont basées sur une architecture lakehouse. Cette conception découple le stockage et le calcul mais les maintient étroitement intégrés. Elle permet à plusieurs clusters de calcul d’accéder au même dépôt de données central (dans un data lake cloud) avec une performance élevée, offrant une plateforme unifiée pour le stockage et le traitement des données.

Modèles d’IA ou régression simple : qu’est-ce qui est le mieux pour les prévisions de ventes ?

Dans la course à l’adoption de l’IA, il est facile de supposer qu’un modèle de deep learning complexe est toujours supérieur à une méthode statistique plus simple comme la régression linéaire. Pour une tâche comme la prévision des ventes, cette supposition peut être une erreur coûteuse. Bien qu’un réseau neuronal sophistiqué *puisse* potentiellement capturer des schémas non linéaires plus complexes dans vos données, il s’accompagne d’une augmentation colossale des besoins en infrastructure, du temps d’entraînement et de la maintenance. Le principe du rasoir d’Ockham s’applique : la solution la plus simple qui fonctionne est souvent la meilleure.

Avant de vous engager dans une approche de deep learning, vous devez vous poser une question critique : le gain potentiel de précision justifiera-t-il l’augmentation exponentielle du coût et de la complexité ? Un modèle de régression linéaire peut être entraîné en quelques secondes sur un seul CPU, est hautement interprétable et nécessite une infrastructure MLOps minimale pour être déployé et maintenu. Un modèle de deep learning pour la même tâche pourrait nécessiter des heures ou des jours d’entraînement sur des GPU coûteux, un pipeline MLOps complexe pour le versioning et le déploiement, et une surveillance continue pour éviter la dérive du modèle (model drift). Ce n’est pas seulement un arbitrage technique ; c’est un arbitrage commercial.

Une amélioration de 1 % de la précision des prévisions grâce à un modèle de deep learning pourrait être révolutionnaire pour une entreprise comme Amazon, car elle se traduit par des milliards d’économies en coûts d’inventaire. Pour une startup, cette même amélioration de 1 % pourrait ne même pas couvrir la facture mensuelle du cloud pour l’entraînement du modèle. Le tableau ci-dessous illustre de manière frappante la différence d’infrastructure entre ces deux approches.

| Aspect | Régression Linéaire | Deep Learning | Différence de coût |

|---|---|---|---|

| Matériel | CPU uniquement | GPU requis | 100x |

| Temps d’entraînement | Secondes | Heures/Jours | 1000x |

| Infrastructure | Minimale | MLOps complexe | 50x |

| Maintenance | Simple | Surveillance continue | 10x |

Pourquoi votre application est-elle lente alors que l’utilisation du CPU semble faible ?

C’est l’un des scénarios les plus frustrants pour un ingénieur : votre tableau de bord de surveillance des performances montre une faible utilisation du CPU, et pourtant votre application est péniblement lente. Vous allouez des CPU plus puissants au problème, mais rien ne change. Ce paradoxe survient souvent parce que le goulot d’étranglement n’est pas la puissance de traitement du cœur du CPU lui-même, mais l’une des nombreuses contraintes non évidentes qui n’apparaissent pas sur un graphique d’utilisation standard. Votre processeur est effectivement « affamé » et attend autre chose.

L’un des coupables les plus courants dans l’écosystème Python est le Global Interpreter Lock (GIL). À cause du GIL, un processus Python standard ne peut exécuter qu’un seul thread à la fois, même sur un CPU multicœur. Pendant qu’un thread s’exécute, tous les autres attendent. C’est pourquoi les analyses de performance montrent que même avec un CPU à 16 cœurs, une application Python multithreadée pourrait n’utiliser qu’un seul cœur à 100 %, laissant les 15 autres inactifs. L’utilisation du CPU pour l’ensemble du système semble faible, mais l’application est limitée par cette exécution monothread.

Au-delà du GIL, plusieurs autres facteurs peuvent causer ce problème de « lenteur avec CPU faible », presque tous liés aux E/S (Entrées/Sorties). Si votre CPU attend constamment que des données soient lues depuis un disque lent, récupérées via un réseau à haute latence, ou transférées de la RAM système vers la VRAM du GPU, ses propres cœurs seront inactifs. Diagnostiquer ces problèmes nécessite d’aller au-delà des simples métriques CPU et d’utiliser des outils de profilage pour comprendre où votre application passe réellement son temps.

- Vérifiez l’attente d’E/S (I/O Wait) : Utilisez des outils comme `top` ou `iostat` sous Linux. Un pourcentage élevé de « wa » ou « %iowait » indique que votre CPU passe un temps important à attendre des données du stockage. Cela pointe vers un disque lent ou un processus de chargement de données inefficace.

- Surveillez le transfert de données GPU-CPU : Utilisez des profileurs comme `nvprof` de NVIDIA ou `Nsight`. Ces outils peuvent visualiser la chronologie des opérations et mettre en évidence les périodes où le GPU est inactif, en attente de copie de données depuis la mémoire du CPU.

- Analysez le pipeline de données : Dans des frameworks comme PyTorch ou TensorFlow, le `DataLoader` est souvent le goulot d’étranglement. S’il ne peut pas préparer les lots de données assez vite pour alimenter le GPU, celui-ci sera affamé. Augmenter le nombre de `num_workers` dans le DataLoader de PyTorch peut souvent résoudre ce problème.

- Profilez l’utilisation de la mémoire : Une forte pression sur la mémoire peut forcer le système d’exploitation à utiliser l’espace de pagination (swap) sur le disque, qui est infiniment plus lent que la RAM. Cela peut paralyser les performances même avec une faible utilisation du CPU.

- Examinez la latence réseau : Si vos données d’entraînement sont stockées à distance, mesurez le temps passé à les récupérer. Une latence réseau élevée peut être un tueur de performances silencieux.

Points clés à retenir

- Maîtrisez l’arbitrage de calcul : Tirez parti des instances spot et de la planification en heures creuses pour réduire les coûts de GPU jusqu’à 90 %, mais assurez-vous que votre architecture est tolérante aux pannes avec un checkpointing robuste.

- Adoptez un modèle hybride « Charge de base et Pic » : Utilisez du matériel sur site pour les charges de travail continues et prévisibles, et basculez vers le cloud pour les tâches massives et ponctuelles afin d’optimiser à la fois le coût et l’évolutivité.

- Concevez pour la thermique et la localité des données : Reconnaissez que la performance sur site est limitée par la densité thermique (kW/rack), nécessitant un refroidissement liquide, et que la performance globale dépend du déplacement du calcul vers les données, et non l’inverse.

Comment gérer efficacement la capacité de calcul pour les charges de travail haute performance ?

Gérer efficacement la capacité de calcul est la dernière couche cruciale pour construire une infrastructure d’IA durable. Ce n’est pas une configuration ponctuelle ; c’est un processus continu d’optimisation, d’automatisation et de gouvernance. Avoir accès à du matériel puissant ne suffit pas. Sans une stratégie de gestion cohérente, vous souffrirez inévitablement soit de coûts prohibitifs dus au surprovisionnement, soit de projets bloqués par manque de ressources. L’objectif est d’atteindre une élasticité avec discipline financière — garantir que vos équipes disposent des ressources nécessaires, exactement quand elles en ont besoin, au coût le plus bas possible.

Une approche multicouche est requise, combinant le dimensionnement correct (right-sizing), l’élasticité et l’automatisation. Ce cadre stratégique, souvent promu par les grands fournisseurs de cloud, déplace la gestion de la capacité d’une tâche manuelle et réactive vers un processus codifié et proactif. C’est l’essence même du MLOps : appliquer les principes DevOps au cycle de vie de l’apprentissage automatique.

Étude de cas : La stratégie multicouche de gestion de capacité de Google Cloud

L’approche de Google Cloud pour la gestion de l’infrastructure d’IA combine trois piliers clés. Le premier est le dimensionnement correct (Right-Sizing) : choisir activement les types d’instances appropriés pour la tâche, en évitant l’erreur courante d’utiliser un GPU massif pour une tâche qui pourrait tourner sur un plus petit. Le deuxième est l’élasticité : utiliser un mélange d’instances réservées à long terme pour la charge de base prévisible et basculer avec des VM Spot pour les pics de demande. Enfin, et surtout, l’automatisation via des plateformes MLOps comme Kubeflow et Vertex AI. Ces plateformes permettent aux organisations d’automatiser la mise à l’échelle, d’orchestrer des flux d’entraînement complexes et de gérer les ressources de manière programmatique, transformant ce qui était autrefois des devinettes manuelles en processus reproductibles et efficaces.

La mise en œuvre de cela nécessite plus que de simples outils ; elle nécessite un changement culturel, souvent formalisé par la création d’un « Centre d’excellence » (CoE) MLOps. Cette équipe centrale établit la gouvernance, les meilleures pratiques et les ressources partagées qui permettent à l’ensemble de l’organisation d’utiliser l’infrastructure de manière efficiente.

- Établissez un cadre de gouvernance : Définissez des politiques claires pour l’allocation des ressources, le marquage (tagging) et les refacturations (chargebacks) afin de créer une responsabilité.

- Mettez en œuvre une surveillance complète : Déployez des outils comme Prometheus et Grafana pour suivre en temps réel les métriques clés comme l’utilisation des GPU, l’utilisation de la mémoire et le PUE (Indicateur d’Efficacité Énergétique).

- Créez des ressources partagées : Construisez et maintenez un registre de conteneurs Docker réutilisables et optimisés et de modèles pré-validés pour éviter que les équipes ne réinventent la roue.

- Formez les équipes : Éduquez activement les data scientists et les ingénieurs sur les implications financières de leurs choix d’infrastructure et sur les meilleures pratiques pour une utilisation efficace.

- Mesurez et optimisez constamment : Suivez et rapportez les métriques commerciales pertinentes comme le coût par modèle entraîné et les taux d’utilisation des ressources pour stimuler l’amélioration continue.

Maintenant que vous disposez des cadres architecturaux et économiques, l’étape suivante consiste à les codifier en une stratégie concrète et exploitable pour votre organisation. Commencez par auditer vos charges de travail actuelles, identifier votre charge de base et calculer votre propre seuil de rentabilité achat-location. Cette approche basée sur les données vous permettra de transformer votre infrastructure d’un centre de coûts en un atout stratégique qui propulse votre innovation.